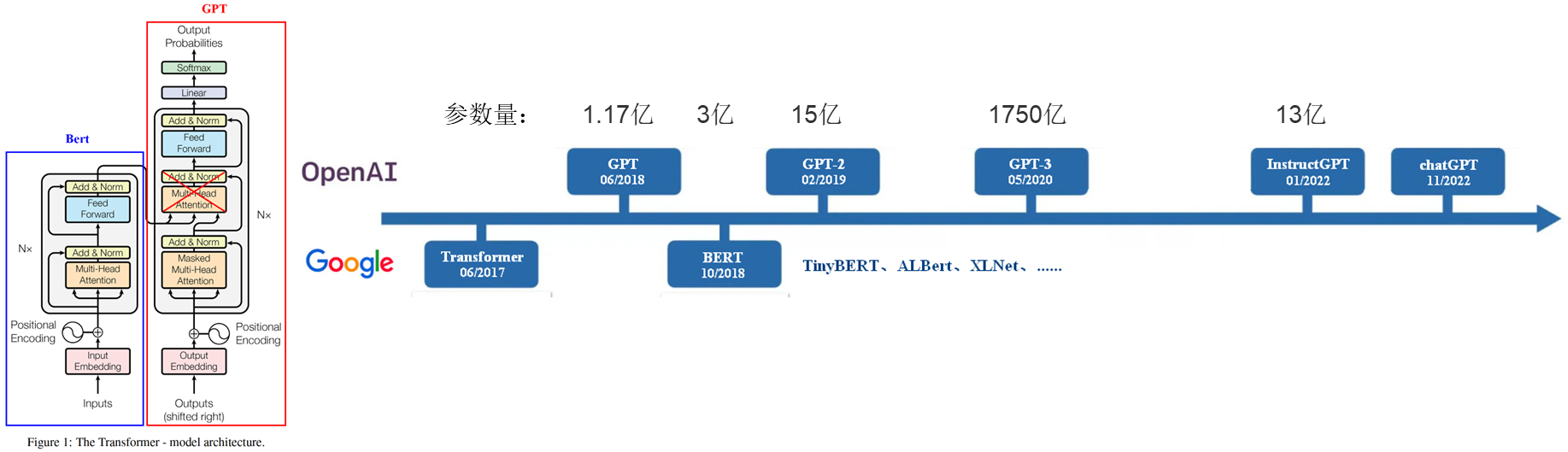

LLM-GPT系列:GPT-1(201806)【1.17亿、5GB】、GPT-2(201902)【15亿、40GB】、GPT-3(202005)【1750亿、45TB】【OpenAI】

GPT1:Imporoving Language Understanding By Generative Pre-training

GPT2:Lanuage Models Are Unsupervised Multitask Learners

GPT3:Language Models Are Few-shot Learners

GitHub:https://github.com/openai/gpt-3

从GPT三个版本的论文名也能看出各版本模型的重点:

- GPT1:强调预训练

- GPT2:强调Unsupervised Multitask就是说下游任务fintune的时候不用重新调整模型结构了

- GPT3:强调Few-shot 就是连finetune都省了,巨大的参数空间,可以直接few-shot甚至zero-shot

前言

Generative Pre-trained Transformer(GPT)系列是由OpenAI提出的非常强大的预训练语言模型,这一系列的模型可以在非常复杂的NLP任务中取得非常惊艳的效果,例如文章生成,代码生成,机器翻译,Q&A等,而完成这些任务并不需要有监督学习进行模型微调。

订阅专栏 解锁全文

订阅专栏 解锁全文

932

932

暂无认证

暂无认证

Twistzz.965: 是不是在求尿布的前缀路径构造的Fptree的有问题

键盘即钢琴: mobaxterm里面也有x服务器,连接远端后,在VSCode里面即可用

weixin_46174832: 例如:假设有两个主题,主题1有4个相关网页,主题2有5个相关网页。某系统对于主题1检索出4个相关网页,其rank分别为1, 2, 4, 7;对于主题2检索出3个相关网页,其rank分别为1,3,5。对于主题1,平均准确率为(1/1+2/2+3/4+4/7)/4=0.83。对于主题2,平均准确率为(1/1+2/3+3/5+0+0)/5=0.45。则MAP= (0.83+0.45)/2=0.64。 为什么对于主题2,平均准确率的分母是5呢,辛苦解答~

Wei_fan_1226: 您好博主,能请教一下您是如何安装transformer-engine么,我在按照https://docs.nvidia.com/deeplearning/transformer-engine/user-guide/installation.html#installation-from-source 安装transformer-engine的过程中出现了building wheels的问题

小Rr: 您好 ,有完整的源码吗