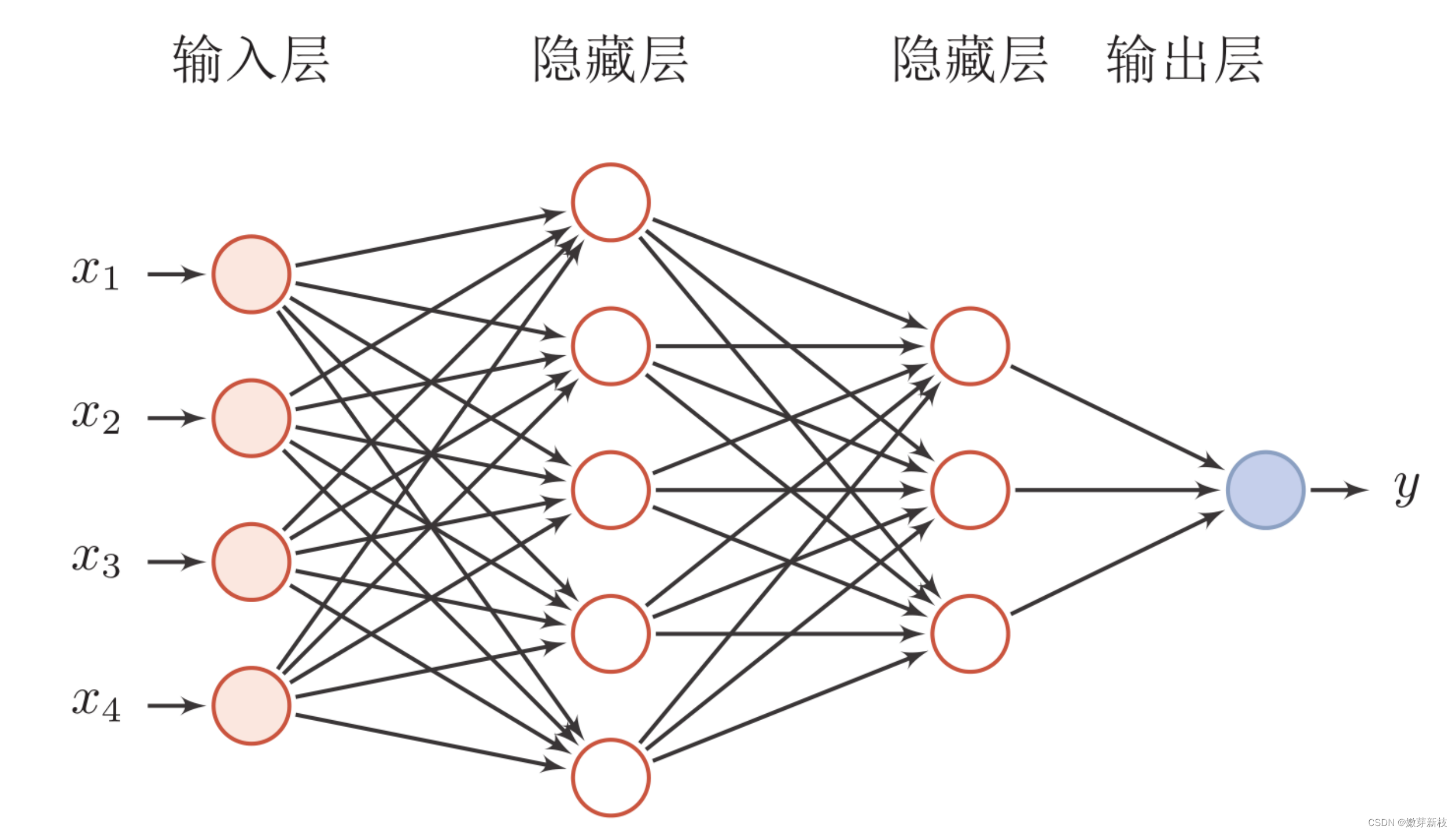

深度学习(二、全连接网络FNN)

在前馈神经网络中,各神经元分别属于不同的层。整个网络中无反馈,信号从输入层向输出层单向传播,可用一个有向无环图表示。

为了引入非线性变换(因为如果没有非线性变换,即使层数再多也只是做了一些仿射函数而已),在各个层中可能会引入一些激活函数(如sigmonid激活函数将值域映射到0~1,tanh激活函数将值域映射到-1~1。)

这个设计初衷最开始是模仿人脑神经元的想法(其实关联并不是特别大),细胞体中的神经细胞膜上有各种受体和离子通道,胞膜的受体可与相应的化学物质神经递质结合,引起离子通透性及膜内外电位差发生改变,产生相应的生理活动:{兴奋}或{抑制}。细胞突起是由细胞体延伸出来的细长部分,又可分为树突和轴突。{树突}(Dendrite)可以接受刺激并将兴奋传入细胞体。每个神经元可以有一或多个树突。{轴突}(Axons)可以把兴奋从胞体传送到另一个神经元或其他组织。每个神经元只有一个轴突。即树突作为输入,轴突作为输出。采用此种方式信息一层一层的传递下去。

通用近似定理:对于具有线性输出层和至少一个使用“挤压”性质的激活函数的隐藏层组成的前馈神经网络,只要其隐藏层神经元的数量足够,它可以以任意精度来近似任何从一个定义在实数空间中的有界闭集函数。即一个两层的神经网络可以模拟任何函数。

模型:y=f5(f4(f3(f2(f1(x)))))

学习准则:L(y,y^∗)

优化:梯度下降 ∂L(y,y^∗) /∂ f^1=∂ f^2/∂ f^1×∂ f^3/∂ f^2×∂ f^4/∂ f^3×∂ f^5/∂ f^4×∂L(y,y^∗) /∂ f^5。采用链式求导法则,可以自动计算。

4233

4233

暂无认证

暂无认证

weixin_45746086: 数据集呢